如何高效地将海量数据导入MySQL数据库?

LOAD DATA INFILE命令或mysqlimport工具来高效加载。需注意设置合适的缓冲区大小和并发线程数,并确保数据文件格式与目标表结构匹配,以提高导入速度并减少内存占用。在面对海量数据库的导入需求时,MySQL数据库展现出了其灵活性和高效性,本文将深入探讨如何有效地将大量数据导入MySQL数据库,确保过程的稳定性与效率,具体分析如下:

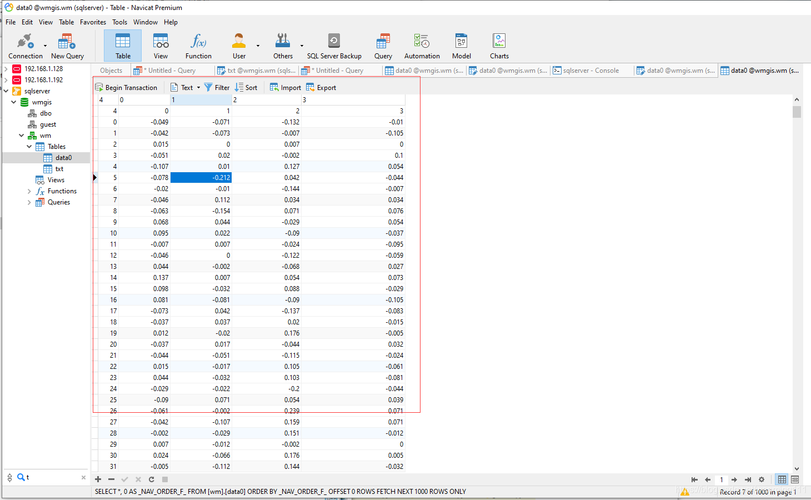

(图片来源网络,侵删)

(图片来源网络,侵删)在准备阶段,需要对数据进行预处理,这包括数据的清洗、格式标准化以及初步的数据分批,数据清洗可以去除冗余和错误的数据输入,而格式标准化确保所有数据在导入数据库前符合预定的格式要求,对于日期和时间的格式,应当统一为ISO标准格式,以避免后续处理中的解析错误,数据分批则是为了避免一次性加载过多数据导致的系统延迟或故障,通过将数据分割成小批次,可以有效控制每次导入的数据量,从而提高整体的数据处理速度和稳定性。

建立数据库连接是实现数据导入的第一步,使用Python等编程语言,可以通过MySQLdb库来建立与MySQL数据库的连接,这一步涉及到指定数据库服务器的地址、登录用户名与密码,以及需要连接的具体数据库名,正确设置这些参数是确保数据库连接成功的关键。

进行大数据量导入时,选择合适的导入策略至关重要,MySQL提供了多种数据导入方法,如LOAD DATA INFILE和INSERT语句,LOAD DATA INFILE是处理大规模数据导入的有效手段,尤其是在预处理阶段已经确保数据格式正确无误的情况下,这种方法可以直接将文本文件中的数据加载到数据库中,大大减少了逐条插入记录的开销,相比之下,虽然INSERT语句在处理小规模数据时足够灵活,但在面对千万级甚至亿级数据量时,其性能往往无法达到要求。

利用事务来管理数据的导入可以显著提升导入的效率和可靠性,通过将多个INSERT操作包含在一个事务中执行,可以减少硬盘I/O操作的次数,提高导入速度,事务还能确保操作的原子性,即在发生错误时可以回滚至初始状态,保证数据的一致性和完整性。

针对具体的海量数据导入操作,还可以采取以下一些优化措施来进一步提升效率:

1、关闭索引:在数据导入前暂时关闭目标表的索引,可以加快数据载入速度,导入完成后,再重新建立索引。

2、优化My.cnf配置:调整MySQL的配置文件(my.cnf),如增加缓冲区大小、调整内存分配,可以提高数据处理效率。

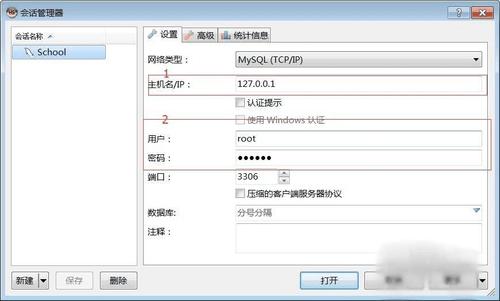

(图片来源网络,侵删)

(图片来源网络,侵删)3、使用批量提交:尽量采用批量提交的方式,减少数据库操作的次数。

针对海量数据库的导入,还应注意以下几点关键因素:

确保网络稳定性,避免在数据导入过程中出现连接中断的情况。

监控数据库性能,及时调整导入策略以防系统过载。

在MySQL中导入海量数据库是一个涉及多方面考量的过程,通过上述策略的实施,可以有效地解决大规模数据导入的挑战,确保数据迁移的平稳和高效。

相关问答FAQs

Mysql导入海量数据时的常见问题有哪些?

(图片来源网络,侵删)

(图片来源网络,侵删)问题1: 数据导入过程中出现性能下降怎么办?

答案: 可以尝试优化MySQL的配置(如调整缓冲区大小),使用更高效的导入工具(如LOAD DATA INFILE),或者调整数据导入的策略(如关闭索引后再导入数据)。

问题2: 如果导入过程中失败,我该如何恢复?

答案: 应确保在开始导入前有完整的数据备份,并使用事务来管理导入过程,这样在遇到问题时可以回滚至初始状态而不影响原有数据,定期检查数据一致性和完整性也是必不可少的。

通过以上讨论和解答,希望能帮助您更好地理解和应对MySQL中海量数据的导入问题。