逻辑回归在神经网络机器学习中扮演着怎样的角色?

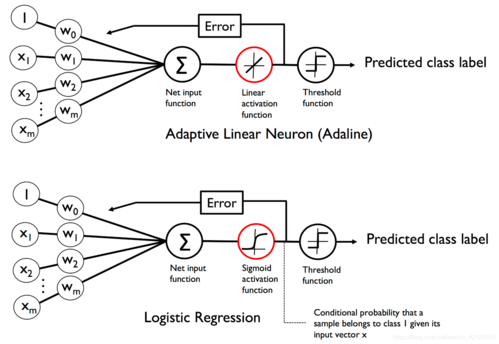

逻辑回归是机器学习中一种非常经典且广泛应用的二分类算法,尽管名称中含有“回归”二字,实质上它主要解决的是分类问题,逻辑回归通过将输入特征与一个sigmoid函数进行线性组合,预测输出标签的概率,尤其适合处理二分类问题,如垃圾邮件检测、欺诈交易识别等。

(图片来源网络,侵删)

(图片来源网络,侵删)逻辑回归基本原理

逻辑回归的核心思想是将线性回归的输出通过一个非线性函数(sigmoid函数)转换成概率值,使其范围在0到1之间,从而能够表示为两个类别的概率,逻辑回归模型可以表示为:

\[ P(Y=1|X) = \frac{1}{1 + e^{(\beta_0 + \beta_1X_1 + \beta_2X_2 + ... + \beta_nX_n)}} \]

\(X_1, X_2, ..., X_n\) 是特征变量,\(\beta_0, \beta_1, ..., \beta_n\) 是模型参数,\(Y\) 是响应变量,取值为0或1。

逻辑回归的优缺点

逻辑回归作为一种广泛使用的分类方法,具有以下优点:

1、实现简单:逻辑回归的参数可以通过极大似然估计法求解,算法本身相对简单易懂。

(图片来源网络,侵删)

(图片来源网络,侵删)2、训练速度快:由于计算量相对较小,逻辑回归的训练速度较快,适合处理大规模数据集。

3、输出结果易于理解:逻辑回归输出的是概率值,直观地反映了样本属于某一类的可能性。

逻辑回归也存在一些局限性:

1、线性决策边界:逻辑回归只能处理线性可分的问题,对于非线性问题,分类效果可能不佳。

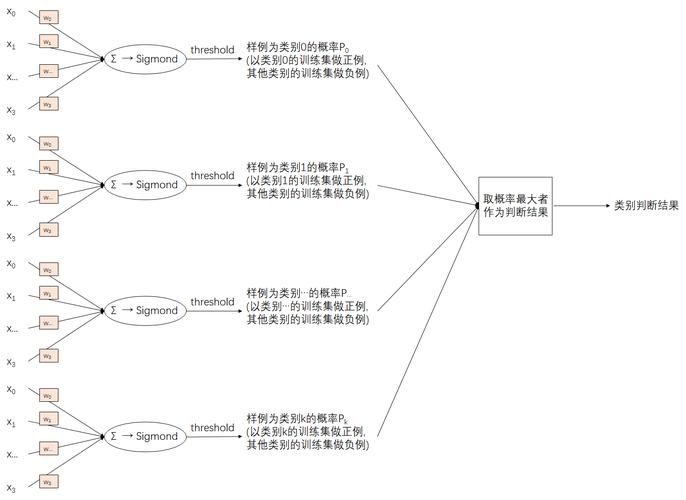

2、处理多分类问题时需使用OnevsRest策略:虽然逻辑回归本质上是一个二分类算法,但可以通过一些策略处理多分类问题。

逻辑回归的应用场景

逻辑回归在多个领域都有广泛的应用,

(图片来源网络,侵删)

(图片来源网络,侵删)1、医疗健康:通过病人的各项生理指标来预测患病的风险。

2、金融风控:评估客户的信用状况,预测贷款违约的可能性。

3、信息安全:识别潜在的网络攻击行为或异常访问。

4、市场营销:分析顾客的特征数据,预测其购买某产品的可能性。

相关配置与优化

在实际应用中,逻辑回归模型的性能可以通过以下方式进一步优化:

1、特征选择:合理选择和预处理数据集中的特征,可以显著提升模型的预测能力。

2、正则化:通过加入L1或L2正则化项,可以避免模型过拟合,提高泛化能力。

3、超参数调优:利用网格搜索、随机搜索等方法寻找最优的超参数组合。

上文归纳与展望

逻辑回归以其简洁高效的特点,成为了许多领域解决分类问题的有力工具,尽管存在一定局限性,但通过合理的特征工程、模型调优以及与其他算法的组合使用,逻辑回归仍然能够在各种实际问题中发挥出色的性能,随着机器学习技术的不断发展,逻辑回归及其变体将继续在更广阔的领域展现其价值。

相关问答FAQs

Q1: 逻辑回归能用于多分类问题吗?

A1: 是的,虽然逻辑回归本质上是一个二分类算法,但可以通过一些策略如OnevsRest(OvR)或OnevsOne(OvO)来处理多分类问题,在OvR策略中,对每个类别都训练一个二分类器,将该类别与其余所有类别分开,而OvO策略则是为任意两个类别之间都训练一个分类器。

Q2: 如何提高逻辑回归模型的性能?

A2: 提高逻辑回归模型性能的方法包括特征选择与预处理、正则化技术的应用以及超参数调优,特征选择可以帮助模型聚焦于最有影响力的变量,减少噪声;正则化技术如L1(Lasso)和L2(Ridge)可以防止模型过拟合;超参数调优则是通过尝试不同的参数组合来找到最佳的模型设置。